上个月参加一个技术峰会,台上演讲嘉宾又在讲HTAP(混合事务分析处理)数据库的美好未来。我扭头看了看身边几个做架构的朋友配资推荐网,大家都在低头刷手机,一脸"又来了"的表情。

散会后一起吃饭,聊起这个话题。有个朋友忍不住吐槽:"HTAP这个概念喊了快五年了吧?每年都说是元年,每家数据库厂商都说自己支持HTAP。但你看现实,有几家企业真正把OLTP和OLAP合在一起用的?我们公司的架构,还是老老实实MySQL做交易,ClickHouse做分析。"

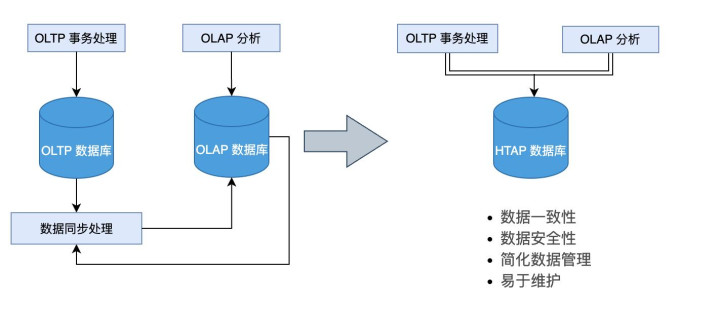

这话说到点子上了。HTAP听起来很美好——一个数据库同时搞定交易和分析,不用再维护两套系统,数据还能实时同步。但为什么喊了这么多年,企业还是不买账?

>>>老规矩,正文开始之前先给大家一份《数据仓库建设解决方案》里面包括从数据标准的规范到报表体系的建设都提供明确的建设思路,高效解决常见的口径不一致、报表查询慢等问题,放在这了>>>>>

今天咱们就掰开了聊聊这个话题。

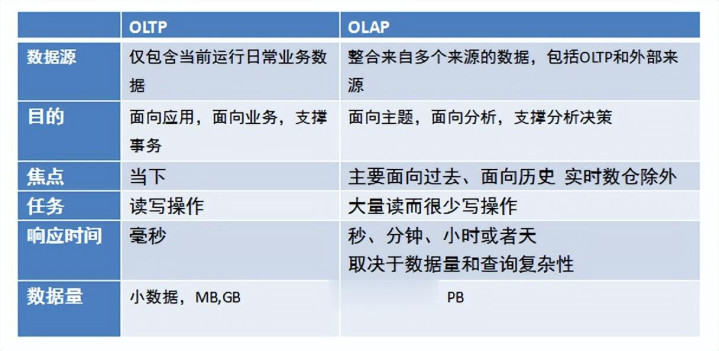

先搞清楚,OLTP和OLAP到底是什么?

可能有些朋友对这俩概念还不太清楚,我先用大白话解释一下。

OLTP(联机事务处理),说人话就是:处理日常业务操作的数据库。

比如你在电商平台下单、转账、改个人信息,这些都是OLTP操作。特点是:高并发、低延迟、单次操作数据量小。就像超市收银员,每次只处理一个顾客的购物车,但要快、要准、要稳定。

典型的OLTP数据库:MySQL、PostgreSQL、Oracle。

OLAP(联机分析处理),说人话就是:用来做数据分析的数据库。

比如老板要看今年整体销售趋势、各个品类的利润分析、用户画像统计,这些都是OLAP操作。特点是:复杂查询、大数据量扫描、对实时性要求相对低。就像市场调研员,要翻遍所有销售记录,做统计分析。

典型的OLAP数据库:ClickHouse、Greenplum、Snowflake。

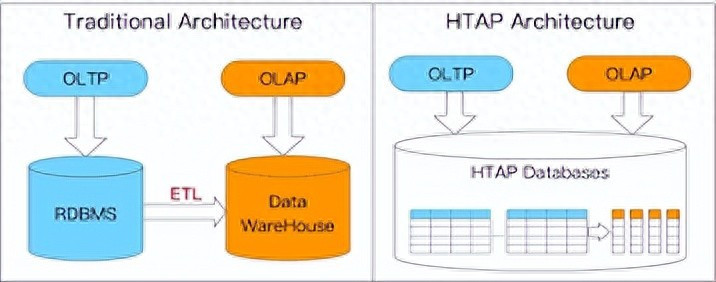

传统架构下,企业会把这两个分开:

OLTP数据库处理业务

通过ETL(数据抽取、转换、加载)把数据搬到OLAP数据库

在OLAP数据库上做分析

HTAP就是想把这两件事合在一起干——一个数据库既能处理高并发交易,又能跑复杂分析。听起来多完美啊!

HTAP的理想很丰满

我记得2018年前后,HTAP这个概念刚火的时候,厂商们画的饼是真的香。

"再也不用维护两套数据库了!" "数据实时分析,无需等待ETL!" "架构简化,成本降低!"

你说这些卖点,哪个不戳中企业的痛点?

我当时还真心动过。有个项目,客户是做O2O外卖平台的,业务场景就特别适合HTAP:

前端要处理海量订单(OLTP)

后台要实时看骑手配送效率、区域热力图(OLAP)

按传统架构,得搭两套数据库,还得实时同步数据。如果用HTAP,一个数据库搞定,多省事啊!

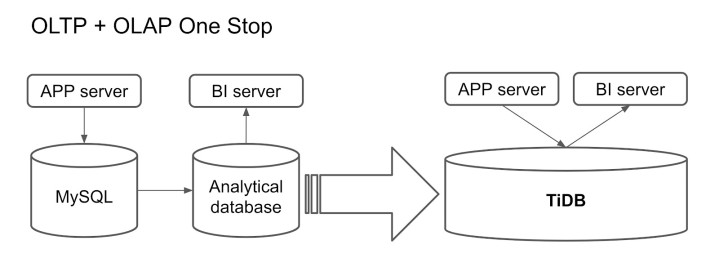

当时我们调研了好几家HTAP数据库——TiDB、OceanBase、PolarDB,技术方案看起来都挺靠谱。白板上画出来的架构图,简洁得让人心动。

但真正落地的时候,才发现理想和现实之间,隔着十万八千里。

现实很骨感:三个绕不过去的坎

第一坎:性能永远是个问题

HTAP数据库的核心思路,是通过"列存+行存"双引擎来实现。简单说就是:

行存引擎处理OLTP(交易类操作)

列存引擎处理OLAP(分析类查询)

数据在两个引擎之间实时同步

听起来很美好,但鱼和熊掌真的能兼得吗?

我见过一个真实案例。某金融科技公司,核心交易系统原本用MySQL,每秒处理几万笔订单,稳如老狗。他们想试试HTAP,把系统迁到了某国产HTAP数据库。

刚开始还挺顺利,交易没问题。但当业务部门开始跑实时报表的时候,问题来了:

OLAP查询一跑,OLTP性能立马掉。

什么意思?就是运营同事在后台跑一个复杂的数据分析查询,前端用户下单的速度就开始变慢。虽然HTAP号称"资源隔离",但实际上CPU、内存、磁盘IO总是共享的。你分析查询扫描几十GB数据,交易请求能不受影响?

他们试过各种优化:调参数、加缓存、限制OLAP查询的资源占用。但要么是分析查询跑得太慢,要么是交易性能打折扣。最后没办法,还是退回了传统架构——MySQL做交易,ClickHouse做分析。

技术负责人后来跟我说:"HTAP理论上可行,但生产环境容不得一点闪失。交易系统是命根子,我可以接受分析慢一点,但绝不能让交易受影响。既然这样,为什么不直接分开?"

这就是HTAP的第一个尴尬:理论上能兼顾,实际上总有取舍。

第二坎:数据一致性的噩梦

HTAP数据库要实现行存和列存之间的实时同步,这本身就是个技术难题。

我见过有的HTAP数据库,行存写入后,需要几秒甚至十几秒才能同步到列存。这意味着什么?你查询的分析结果,永远是"过去时",不是真正的实时。

这对有些业务场景来说,是致命的。

比如电商大促,运营团队盯着实时大屏看销售数据。你告诉他数据有10秒延迟?对不起,10秒钟能卖出去几万单,这延迟根本不能接受。

还有更诡异的问题:一致性保证。

我听一个朋友吐槽过,他们用某HTAP数据库,偶尔会出现这种情况:OLTP查询和OLAP查询,同一个时间点,查出来的数据不一致。虽然概率很低,但这种不确定性,让人用起来心里发虚。

反观传统架构,虽然OLTP和OLAP分开,但至少各自的一致性是有保证的。OLAP数据是通过ETL定时同步的,延迟是延迟了,但至少你知道这个延迟是可控的、可预期的。

"宁愿要一个确定的延迟,也不要一个不确定的实时。"这是很多架构师的心声。

第三坎:运维复杂度没有降低,反而更高了

HTAP数据库宣传的一大卖点是"简化架构",但实际用起来,运维复杂度反而更高。

为什么?因为你要同时懂OLTP和OLAP的优化逻辑。

传统架构下,MySQL的DBA专注于交易优化,ClickHouse的工程师专注于查询优化,各司其职。但HTAP呢?你得既懂行存索引、事务隔离,又懂列存压缩、查询并行化。

而且,HTAP数据库通常比较新,文档不够完善,社区不够活跃,遇到问题很难找到现成的解决方案。我见过有的团队,为了搞定一个HTAP数据库的性能问题,花了一个月时间反复测试、调优,最后发现是个Bug,只能等厂商修复。

"用MySQL遇到问题,网上搜一下,十有八九能找到答案。用HTAP数据库遇到问题,只能提工单等厂商回复,慢死了。"一个运维工程师跟我吐槽。

还有一个现实问题:人才稀缺。

市场上熟悉MySQL、PostgreSQL的DBA一抓一大把,但懂HTAP数据库的呢?凤毛麟角。企业要么花高价招人,要么内部培养,无论哪种,成本都不低。

所以你看,HTAP数据库并没有真正"简化"企业的技术栈,反而增加了新的复杂度。

企业的真实需求,其实没那么"HTAP"

说到底,HTAP数据库解决的是什么问题?实时性。

厂商说:你看,用HTAP就不用等ETL了,数据实时同步,分析结果立刻出来。

但现实是:大部分企业的分析场景,根本不需要"秒级实时"。

我问过很多企业的数据分析负责人,他们做的大部分报表和分析,T+1(第二天看昨天的数据)就够了。甚至有的场景,一周更新一次都没问题。

真正需要"实时分析"的场景,其实很少:

电商大促的实时监控

金融交易的风控分析

物流配送的动态调度

这些场景,占企业整体分析需求的比例,可能不到10%。

而对于这10%的场景,企业往往会用更专业的解决方案:

实时数仓(如Flink + ClickHouse)

流式计算(如Kafka + Spark Streaming)

内存数据库(如Redis)

专门的工具,反而比"万金油"的HTAP更可靠。

至于剩下90%的分析场景,传统的"OLTP + 定时ETL + OLAP"架构,已经足够用了。虽然有延迟,但稳定、成熟、可靠。

企业要的不是最先进的技术,而是最合适的方案。

还有个更现实的问题:迁移成本太高

就算HTAP真的又好又稳,企业想用,也得面对一个残酷的现实:迁移成本。

大部分企业的核心系统,已经在MySQL或Oracle上跑了好几年,甚至十几年。业务逻辑、存储过程、索引优化,都是针对这些数据库特性设计的。

你现在让他们迁移到HTAP数据库?

代码要改

SQL要适配

性能要重新测试

数据要迁移

团队要培训

这是一个浩大的工程,风险高、周期长。而且就算迁移成功了,能带来多少收益?未必有多少。

既然现有架构能用,为什么要冒险去换?

我见过一家零售企业,IT总监对HTAP很感兴趣,想做技术升级。但他把迁移方案报给老板,老板直接问了三个问题:

"迁移要花多少钱?"

"迁移期间会不会影响业务?"

"迁移完了能带来什么价值?"

IT总监想了半天,发现这三个问题都不好回答。最后项目就不了了之了。

这就是企业决策的逻辑:ROI(投资回报率)要算得过来账。

真正在用HTAP的,都是什么企业?

说了这么多HTAP的槽点,那是不是说HTAP就完全没用?也不是。

我见过一些企业,确实在用HTAP数据库,而且用得还不错。他们有什么共同特点?

第一类:从零开始的新项目

没有历史包袱,可以从头设计架构。这种情况下,选HTAP的成本最低。

比如一些创业公司,业务刚起步,数据量还不大,选个HTAP数据库,既能支撑交易,又能做分析,挺香的。

第二类:云原生企业

直接用云厂商的HTAP数据库服务,比如阿里的PolarDB、腾讯的TDSQL。这些服务已经比较成熟,而且有云厂商的技术支持兜底,风险相对可控。

第三类:对实时性有极致要求的场景

比如某些金融场景、智能制造场景,确实需要实时分析交易数据。这种情况下,HTAP的价值就能体现出来。

但这三类企业,加起来占市场的比例,真的不大。

那企业该怎么做?

聊了这么多,可能有人要问:那我们企业到底该怎么办?继续用传统架构?还是尝试HTAP?

我的建议是:别被概念绑架,根据实际需求选方案。

如果你是中小企业

老老实实用成熟的开源方案:

OLTP:MySQL或PostgreSQL

OLAP:ClickHouse或Doris

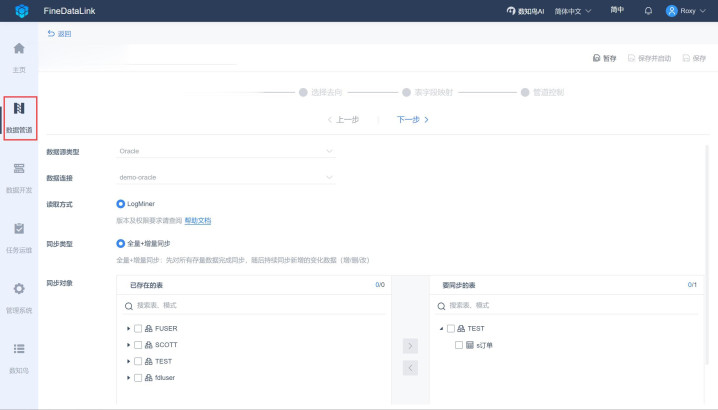

数据同步:用CDC(变更数据捕获)工具,比如FineDataLink

这套方案成熟、稳定、社区活跃,遇到问题好解决。而且成本可控,不用花大钱买商业数据库。

特别是数据同步这块,以前企业都是自己写ETL脚本,现在有专门的数据集成工具,像FineDataLink这种,可以实时捕获MySQL的变更,自动同步到ClickHouse。配置简单,还支持数据清洗和转换。

这样一来,你也能实现"准实时"分析,延迟可以控制在几秒内,对大部分场景都够用了。

如果你是大型企业

可以考虑"混合架构":

核心交易系统,该用Oracle就用Oracle,稳定压倒一切

实时分析场景,用Flink + ClickHouse的流式架构

离线分析场景,搭建数据仓库(如Hive或Snowflake)

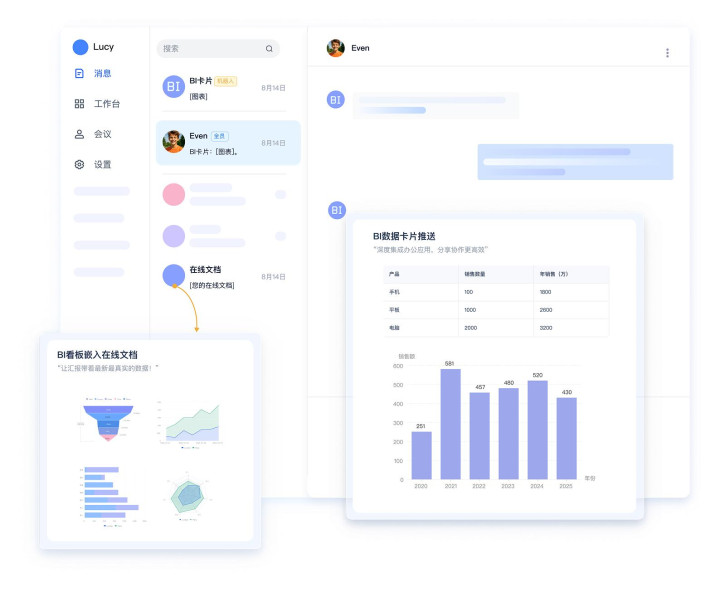

业务人员自助分析,用BI工具(如FineBI)

这种架构灵活性高,各个组件各司其职,出了问题也好排查。

特别是BI这一层,很关键。我见过很多企业,底层数据库搞得很复杂,但业务人员还是看不到想要的数据。为啥?因为没有好用的BI工具。

像FineBI这种,可以连接多个数据源——你的MySQL、ClickHouse、数据仓库,都能接进来。业务人员自己拖拖拽拽就能做分析,不用每次都找IT部门。这样一来,底层数据库怎么架构,对业务人员来说是透明的。

如果你真的想试HTAP

建议从非核心业务开始试点,比如:

用户行为分析系统

运营报表系统

内部管理系统

这些系统即便出了问题,影响也不大。试点成功了,再考虑扩大范围。

千万别一上来就把核心交易系统迁移到HTAP,那是找死。

未来会怎么样?

说实话,我不觉得HTAP会完全取代传统的"OLTP + OLAP"架构,至少短期内不会。

原因很简单:专业的事,还是要专业的工具来做。

就像你不会指望一辆SUV既能越野又能跑赛道,虽然它声称"全能",但真正玩越野的还是会选牧马人,玩赛道的还是会选保时捷。

HTAP数据库会有它的一席之地,但不会是唯一答案。

真正的趋势,我觉得是:数据架构会越来越"平台化"、"服务化"。

企业不会纠结于用哪个数据库,而是会构建一个灵活的数据平台:

底层可以是多种数据库并存

中间层有数据集成工具(如FineDataLink)打通各个数据源

上层有BI工具(如FineBI)让业务人员自助分析

数据库只是这个平台的一部分,不再是核心。

这样的架构,才能真正应对企业快速变化的业务需求。

写在最后

HTAP数据库喊了五年,为什么企业还是OLTP和OLAP分开用?

因为企业不是技术的试验田,而是要解决实际问题。

成熟、稳定、可控,永远比先进、炫酷、概念更重要。

我不是说HTAP不好,它代表了一个技术方向,也在不断进步。但企业在做技术选型的时候,不能被概念忽悠,要看实际效果、算投入产出、考虑风险。

分开用OLTP和OLAP,虽然"土"了点,但它就是管用。这就够了。

对此,您怎么看?欢迎在评论区分享您所在企业的数据架构选型经历配资推荐网,是选了HTAP还是坚持传统方案?都踩过哪些坑?

鑫盛优配提示:文章来自网络,不代表本站观点。